Anthropic no es lo que parece

El finde pasado estuve en Santiago de Compostela, Galicia, dando una charla sobre cómo están las cosas en Youtube (mal). Esa fue la razón por la que no hubo newsletter ese domingo.

Pido disculpas, pero entiendo que cuando alguien te abre las puertas de su bandeja de entrada, más te vale honrar la invitación y no enviar un correo redactado de prisa y corriendo después de un evento que te ha dejado el cerebro frito.

Lobotomía por socialización. Solo lo entenderán los introvertidos.

Fue divertido el evento. Cierto es que, nada más llegar, noté cierta animadversión en el ambiente. Un aire frío que recorría el espacio cada vez que se mencionaba la palabra IA. David Cuesta, el organizador, cogió el micrófono y lo dijo cuando entré en la sala, tarde, tratando de pasar desapercibido.

Llegué tarde porque había quedado para desayunar con mi amigo Antonio, un hacker que está vibecodeando la máquina de exploit definitiva, pero solo después de terminar su jornada de trabajo real de ciberseguridad en el que no usa LLMs.

"Luego hablaremos de lo que has dicho sobre la IA, porque no sé si estamos muy de acuerdo...", dijo David.

Bueno. Yo estoy encantado de hablar con todo el mundo, y si hay pique mejor.

Era un evento de webmasters y gente de marketing o sea que ahí le sacan brillo al ChatGPT.

El primero en acercarse a hablar del tema me dijo que Claude es el futuro. Le pregunté dos cosas: cómo podría ser útil para mi trabajo (siempre dispuesto a aprender) y cómo puede ser útil para la gente corriente.

Para mi trabajo su mejor respuesta fue que puedo pasar el vídeo por Claude y que me saque unas marcas de tiempo para dividir el vídeo en capítulos.

No fue un gran aporte.

Para otra persona, me contó cómo una allegada está estudiando para sacar unas oposiciones. Descubrió Claude Code y, sin tener conocimientos técnicos de programación, ella sola consiguió, a base de prueba y error, desarrollar una especie de app que le hacía tests con el temario.

Me imaginé a la allegada peleando con Claude Code mientras el resto de opositores estudiaban en la biblioteca. No iba mal encaminada para ser funcionaria.

Después de eso di mi charla.

Hablé sobre cómo Youtube ha cambiado la pantalla de inicio para beneficiar a los shorts. Subí un clip a mi canal de Youtube:

Irónicamente ese short está funcionando mejor que los vídeos largos que he subido últimamente.

Luego llegó la cena. Después del evento se hace una cosa que se llama beerworking o sea que para la hora de cenar las mejores ideas ya flotaban por el ambiente. Yo como ya no bebo solo estaba ahí para escucharlas.

Un compañero me comentó que junto a su pareja había diseñado una app con Claude Code. La función de la app: clasificar las películas por duración, género, y tal, para que les recomiende qué ver.

¿Tienes miedo a perder el tiempo viendo una peli que no te gusta? Pásate una tarde vibecodeando una app para que la inteligencia artificial elija por ti. Así, si de todos modos la peli no te gusta, al menos ha sido decisión de la IA.

Jaque mate destino.

Entonces volvió David Cuesta pero no me dijo nada de la IA. Me dijo que Estados Unidos había bombardeado Irán y que luego Irán había respondido bombardeando a todos y...

Poco más. Ya me informaría.

Regresé a mi humilde morada, un hotel frente a la discoteca más chunga de Santiago – según me informó Antonio–, y reflexioné sobre si el alcohol es un lubricante social, como culturalmente se sostiene, o un anestésico para que no te molesten los gritos de la gente y el desentono de un concierto de covers madrileños mientras intentas escuchar a tu interlocutor.

Pero no os gusta que hable de lo del alcohol. Solo queréis que hable de IA. ¿Qué pensáis que es esto? ¿Un artículo de Expansión?

Claude es la IA de los buenos, ¿no?

Cuando me puse a informarme sobre lo que estaba pasando en Irán (abrí Instagram), vi una noticia que decía que Anthropic, la startup detrás de Claude, se había negado a colaborar con el Departamento de Defensa (ahora llamado Department of War) para que las fuerzas estadounidenses usaran su IA.

Esto fue bastante escandaloso porque el secretario de defensa respondió calificando a Anthropic como supply chain risk. En castellano: riesgo en la cadena de suministro.

En cristiano: dicen que Anthropic no es seguro y que, por tanto, las empresas que tienen contratos estatales no deben usarlo. Por ejemplo: Microsoft ha dicho que seguirán integrando la tecnología de Anthropic en sus clientes, a excepción de los clientes que trabajan o tienen algo que ver con el Departamento de Defensa.

Pero, ¿a qué viene todo esto?

A que Anthropic ha exigido que su tecnología no se use para los dos siguientes casos:

1- Crear armas de aniquilación autónomas.

2- Vigilar masivamente a los estadounidenses.

Esas eran las dos exigencias de Anthropic. Las dos únicas exigencias.

Desde el DoW les dijeron que a dónde iban flipándose. Que el contrato era simple: usarían su tecnología de cualquier forma que la ley amparase (all lawful purposes).

Y ya está. Se divorciaron, el rarito de Sam Altman entró en el descuento y fue OpenAI quien firmo el acuerdo con el DoW. Acto seguido la gente empezó a desinstalar masivamente ChatGPT y Claude ganó una batalla de marketing histórica.

De hecho, el resultado no fue solo que la gente desinstalara ChatGPT, sino que empezaron a instalar Claude en su lugar. Lo que puede que no sepan es que, Claude, adalid de la libertad y de los derechos humanos, no es que haya dicho "no a la guerra". Es que lleva trabajando con el DoW desde el 2024. En noviembre de 2025 se asoció con Palantir para juntar sus IAs y capturar a Maduro. En enero de 2026 se presentó a un concurso del Pentágono con un premio de 100 millones de dólares. La propuesta: usar Claude para traducir comandos de voz de un comandante para coordinar un enjambre de drones de guerra.

El concurso lo ganó SpaceX & Xai.

Lo que parece es que Anthropic se ha echado el pisto. Le gustaba que su tecnología se usase en la guerra, pero toda su imagen se basa en ser los buenos. Para continuar con su narrativa ha puesto dos condiciones que, de todos modos, su tecnología no puede llevar a cabo. Al menos todavía. Oficialmente Claude se usaba para "análisis de inteligencia", no sabemos exactamente de qué forma.

Pero me sorprende que Claude, una LLM, pueda ser útil para todo eso: controlar enjambres de drones, crear armas autónomas y vigilar masivamente a los estadounidenses. Los Israelíes, por ejemplo, tienen Lavender, una IA (no LLM) que analiza datos masivamente y mediante machine learning les ayuda a seleccionar objetivos (con un 10% de errores, según reportes). Lavender forma parte de un ecosistema de IAs específicas que Israel utiliza en la guerra. IAs específicas como The Gospel o Where is daddy.

Es posible que el DoW cuente ya con otras IAs específicas para la guerra.

Es raro el movimiento de Anthropic. Creo que pusieron dos condiciones que, de todos modos, no podían cumplir. De traducir las órdenes de voz a un lenguaje que controla unos drones, a que el dron lo controle la IA hay un trecho.

Y, de hecho, no es que Anthropic no quiera diseñar armas autónomas. Según el artículo de Bloomberg que sacó la noticia de los enjambres de drones, "la empresa quería establecer un programa de investigación conjunta para colaborar con el Pentágono en el desarrollo y la evaluación de capacidades de armas autónomas de manera segura".

Vamos, que se calientan más con las armas que los viejos en la cena de navidad cuando salen las historietas de la mili.

Esto parece más un movimiento de marketing que no llegaron a calcular bien.

Han recibido publicidad y ganado nuevos usuarios porque la gente todavía no sabe que son la otra cara de la misma moneda, pero no sé hasta qué punto han salido ganando.

Veremos cómo afecta a largo plazo la denominación de riesgo de cadena de suministro.

¿Pero qué es Claude?

A finales de 2020, Dario Amodei y su hermana, Daniela Amodei, salieron de OpenAI por motivos "éticos". Estaban preocupados por los peligros que acarreaba una tecnología como el modelo de lenguaje generativo de ChatGPT, así que fundaron Anthropic en 2021 para crear un LLM que fuera seguro y controlable.

Así salió Claude, en 2023, que tras las últimas actualizaciones y, sobre todo, los modelos que salieron hacia finales de 2025, se convirtió en el líder indiscutible entre los frikazos de la IA.

Esto se debe a que enfocaron sus modelos a ser los mejores para programar. Por si vivís en una cueva (a este paso una gran idea), Claude Code es el sueño erótico de los informáticos hoy en día.

Es una relación un poco tóxica, tengo que decir.

Hace poco Dario Amodei dijo que estamos a unos 6-12 meses de que la IA haga todo el trabajo de los desarrolladores de software.

Bueno, a decir verdad, también lo dijo hace exactamente un año. Mismo periodo: unos 12 meses.

Ah, en 2024 también dijo que la inteligencia de la IA avanzaría hasta ser "tan buena como un ganador de un premio nobel". ¿La fecha de la predicción? 2025, 2026 o 2027. Alguno de esos años.

¿Es un cachondeo?

Lo es.

Por una simple razón: esas predicciones son una campaña de marketing que pretende atraer inversores para subsidiar un negocio que por ahora no se sostiene, y para calentar una salida a bolsa que puede estar cerca. Según informaba el Financial Times en diciembre de 2025, Anthropic se dirigió a la firma de abogados Wilson Sonsini, y a bancas de inversión, con el objetivo, según rumores, de tantear la salida a bolsa este 2026.

También decía el artículo que los inversores de Anthropic estaban muy calientes con que Anthropic llevara la delantera y saliera a bolsa antes que OpenAI.

Ahora no sabemos en qué punto están las cosas. ¿Cómo afecta el supply chain risk en una hipotética OPV? Ni idea. Veremos cómo evoluciona este asunto.

Mientras tanto, Anthropic sigue ganando la guerra del marketing. Ahora mismo su imagen es la de una compañía con una tecnología tan avanzada que podría hacer armas autónomas, pero no quiere.

Qué grandes, bro.

Tienes que hacerte granjero o mecánico de motos

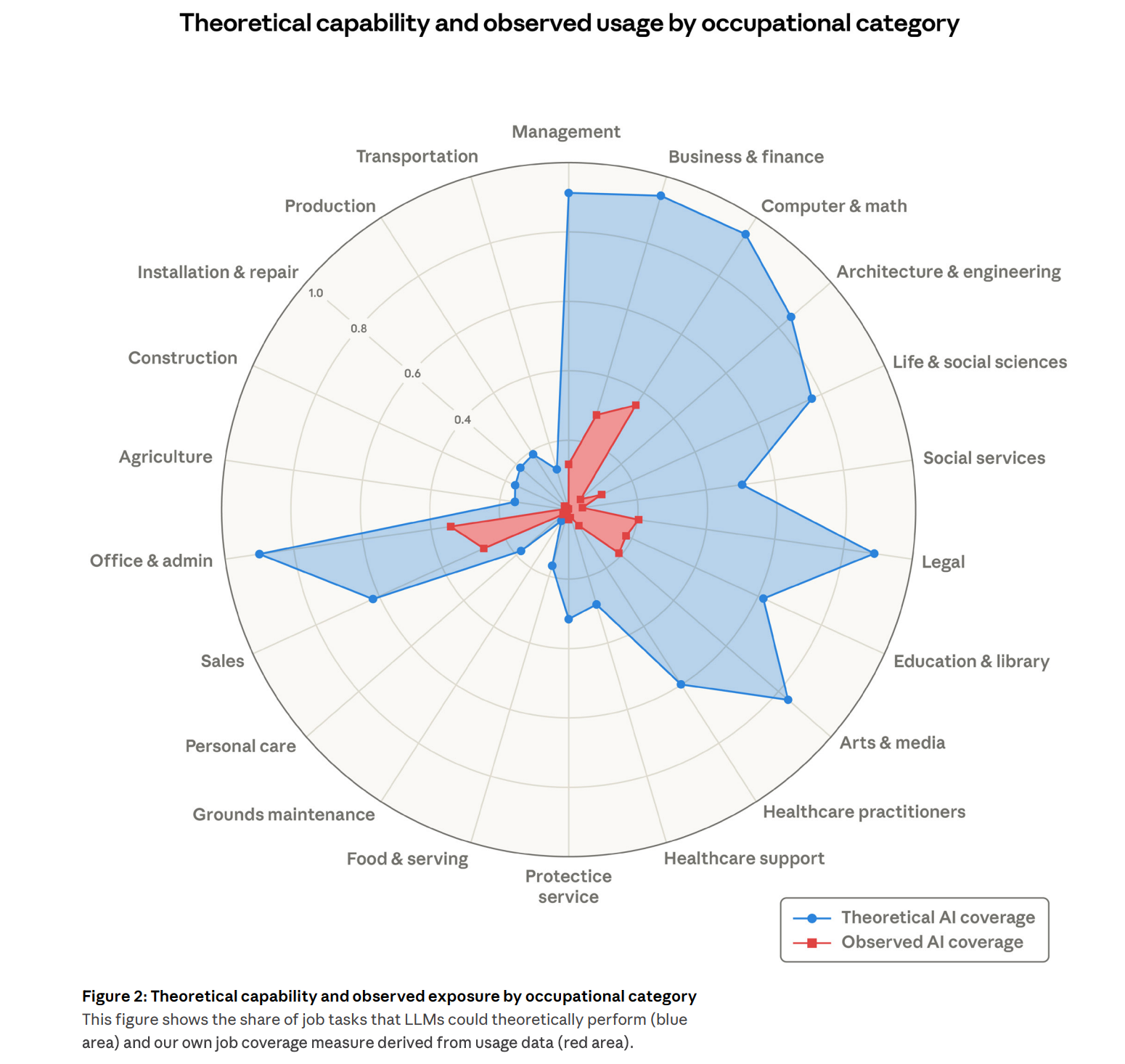

El viernes salió el siguiente gráfico y no tardé en verlo en stories y publicaciones varias de internet. Se trata de un estudio que habla de cómo la IA va a quitarnos el trabajo. En este dibujito tan mono se ve una comparación: los trabajos que la IA puede teóricamente hacer, y aquellos que realmente está haciendo.

Esto se hizo muy viral. Un anticipo de dónde estamos y hacia dónde vamos. Según el gráfico, el área que teoriza sobre los trabajos que serán reemplazados por IA es enorme. Y por lo que vemos en rojo, esto no ha hecho más que empezar.

Bien.

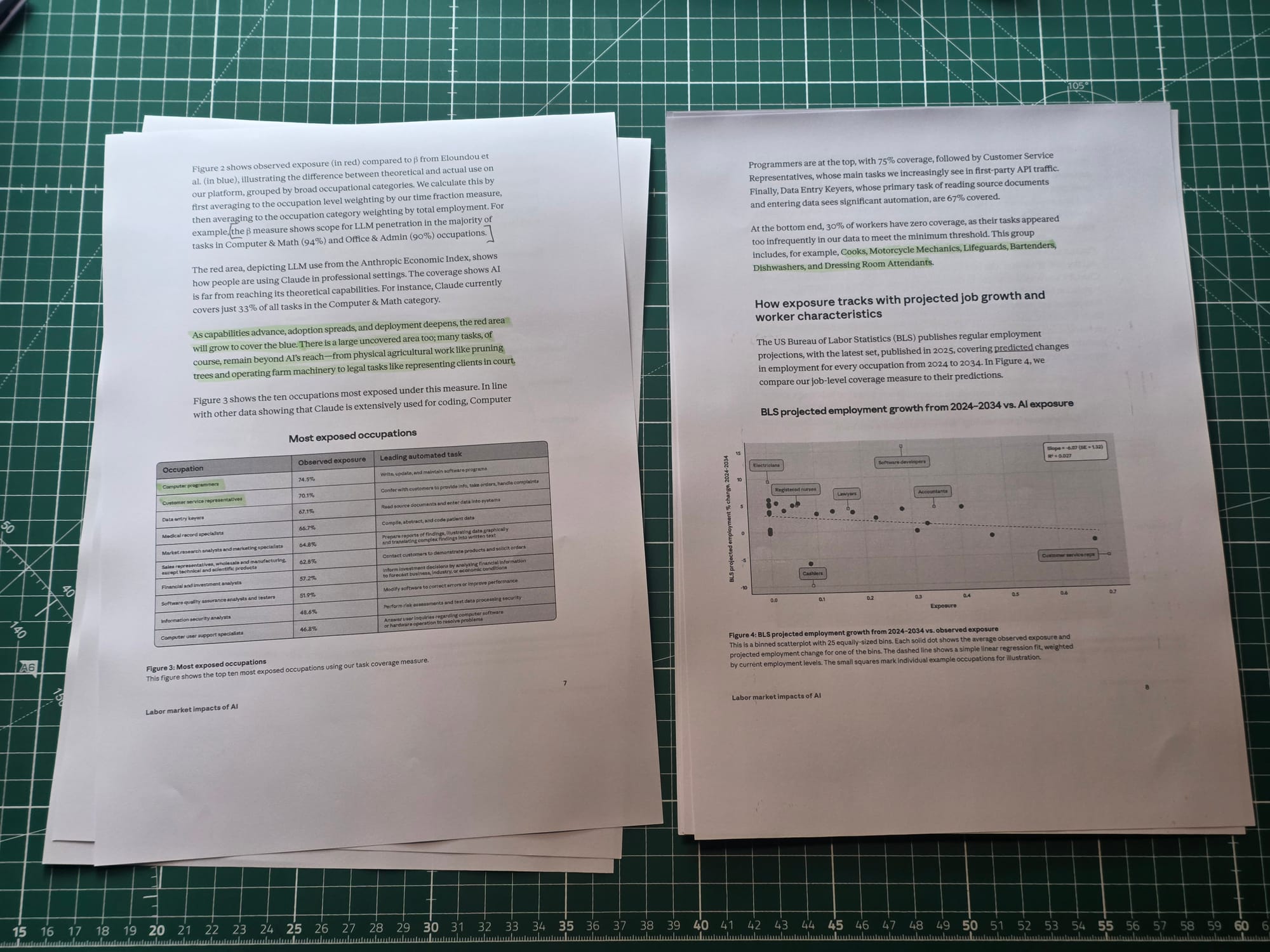

Esa captura viene de un estudio recién publicado. Por Anthropic. Busqué el estudio, lo descargué, y en lugar de pedirle a una IA que me lo resumiera, lo imprimí y lo leí. Así de interesante es mi vida, vivo al límite.

Lo primero: debo admitir que no soy un hombre de ciencias. Aunque el estudio parece más bien de ciencias sociales 😎

Dejé aeronáutica para entrar en audiovisuales. No tengo un MBA, tengo un máster en escritura de guiones. Puede que no sepa mucho de ciencia, pero sí sé sobre el arte de contar cuentos. Y, amigos, vaya cuentito se acaba de sacar Anthropic de la manga.

El método para elaborar ese gráfico ha sido el siguiente.

Primero se han basado en un estudio previo de 2023, titulado GPTs are GPTs. Ese estudio categoriza tareas de diferentes trabajos dependiendo de su grado de exposición a los LLM. En concreto, se dice que una tarea está expuesta si se puede hacer un 50% más rápido con un LLM, manteniendo o mejorando la calidad.

Para ser honestos, ese estudio es algo más complejo. Clasifica la exposición dependiendo de si puede hacerse con un LLM, si se necesita un software específico además del LLM, o una integración completa entre software y LLM.

De todas formas, eso da igual. Vamos al estudio de Anthropic. Explican brevemente que, teóricamente, una tarea como "autorizar la renovación de medicamentos y proporcionar recetas a las farmacias", está totalmente expuesta. Teóricamente lo puede hacer una LLM.

Teóricamente también podría escribir esta newsletter, pero no voy a entrar en eso.

La cuestión es que han cogido una media de lo expuestas que están esas tareas dentro de cada ocupación, le han dado el valor a la ocupación y han creado ese gráfico.

Luego han mirado en sus estadísticas a ver si esas tareas se están haciendo con la API de Claude, han hecho la media, y han puesto la parte roja del gráfico.

Y así es cómo han creado esa aberración de gráfico, que en una muy cuestionable forma de radar, insinúa que algunas ocupaciones están "cooked", como dicen los jóvenes hoy en día.

Pero no os preocupéis porque también nos dicen qué ocupaciones se salvan: cocineros, mecánicos de motos (los de coches parece que no se salvan), socorristas, camareros, lavaplatos y asistentes de vestuario (¿espera eso es un trabajo?).

En fin. Para mí esto es un timo porque:

1- Extrapola el uso de LLMs en tareas concretas a ocupaciones completas, e insinúa que es el fin de categorías. Ejemplo: ahora la gente escribe correos con ChatGPT, y algunos en la oficina envían correos. ¿O sea que se acabó el trabajo de oficina? ¿En serio? ¿Justo ahora que WeWork estaba remontando?

2- Está diseñado para crear FOMO. Lo azul es lo que va a pasar. Lo rojo donde estamos. Entra en Claude y empieza a usarlo ya por 20$ al mes si no quieres quedarte fuera.

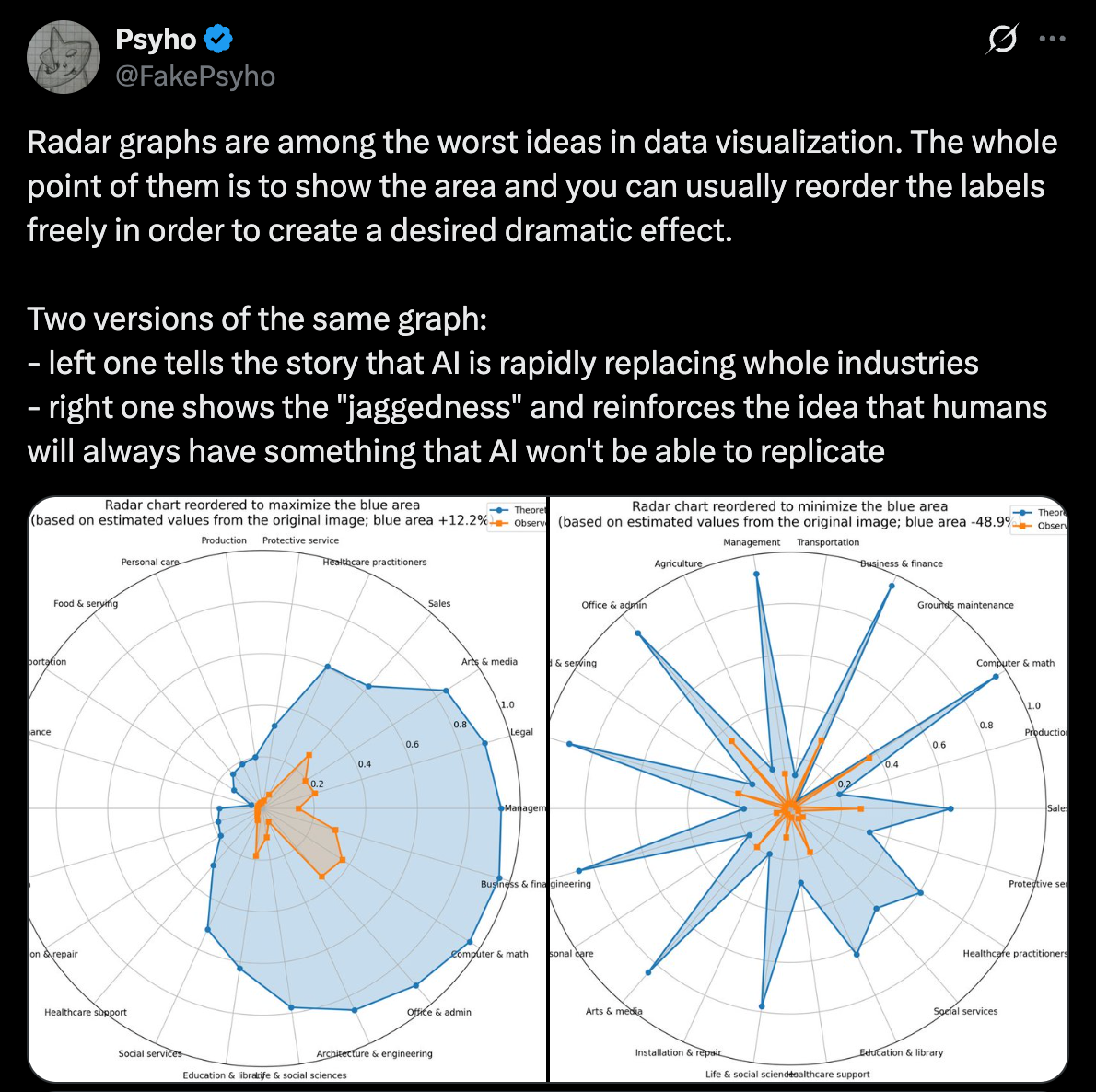

3- El propio gráfico en forma de radar es engañoso, como ya lo han señalado unos cuantos. "Puedes reordenar las categorías para crear el efecto dramático que desees". Literalmente: storytelling.

El resto del estudio es un lío: dicen que puede que ya haya habido algunos despidos por la IA, o puede que no. Más bien dicen que se ha observado que los nuevos contratados jóvenes en determinados sectores haya bajado desde que salió ChatGPT. Pero tampoco dicen que sea por un chatbot.

Sé que alguno me sacará esta noticia a colación: Jack Dorsey, fundador de Twitter, ha despedido a 4.000 personas de su empresa, Block, y ha dicho sin pelos en la lengua que es por la IA. Que el negocio va de locos, pero que ahora con la IA no necesitan a tanta gente.

“La IA no reduce el trabajo. Lo transforma, lo acelera, y en los casos más honestos, lo reemplaza”, dijo, y Block subió más de un 20% en bolsa.

Como curiosidad: a la bolsa le encantan los despidos.

Pero hablando de casos honestos, muchas empresas tecnológicas empezaron a contratar (y se pasaron un poco) durante la pandemia. Hubo una especie de boom extraño. Block tenía 3.900 empleados en 2019. En 2022 tenía 12.500.

Desde ahí ha ido despidiendo.

Block no es el único caso, pero curiosamente Dorsey es conocido porque tenía un montón de empleados en Twitter, que Musk despidió nada más llegar porque la red social podía funcionar sin ellos. La IA nada tuvo que ver aquella vez.

La verdad es que pocos se han comido la narrativa de Dorsey, y le han acusado de utilizar la excusa de la IA para justificar los despidos masivos.

Ahora, ¿es esa toda la película?

Los Claud Boys

Sé que hay desarrolladores y entrepreneurs que usan Claude entre los suscriptores de esta newsletter. Algunos os enfadáis cuando hablo de estas cosas y otros os lo tomáis de cachondeo. Hay quien esta de acuerdo con lo que digo. Pero os quiero animar a que respondáis a este correo con cualquier aporte, ya sea insulto o comentario constructivo, por si en un futuro me apetece hacer un vídeo sobre Anthropic.

Mi primera pregunta para vosotros es:

¿Por qué pagáis 200$ al mes a una empresa que literalmente dice que os va a quitar el trabajo?

¿Qué? ¿Que gracias a tu tecnología me voy al paro en 6 o 12 meses? Toma todo mi dinero.

En realidad ya sé la respuesta: porque en el fondo no creéis todo lo que dice Dario Amodei.

Sin embargo me he topado con demasiada gente que me habla de lo increíble que es Claude. Bro, que ni siquiera tienes enlace de afiliado. ¿No?

Una de las cosas más curiosas que se dicen de Claude es que hace el trabajo de varios desarrolladores junior pero es más barato, no come, no duerme, y no paga impuestos.

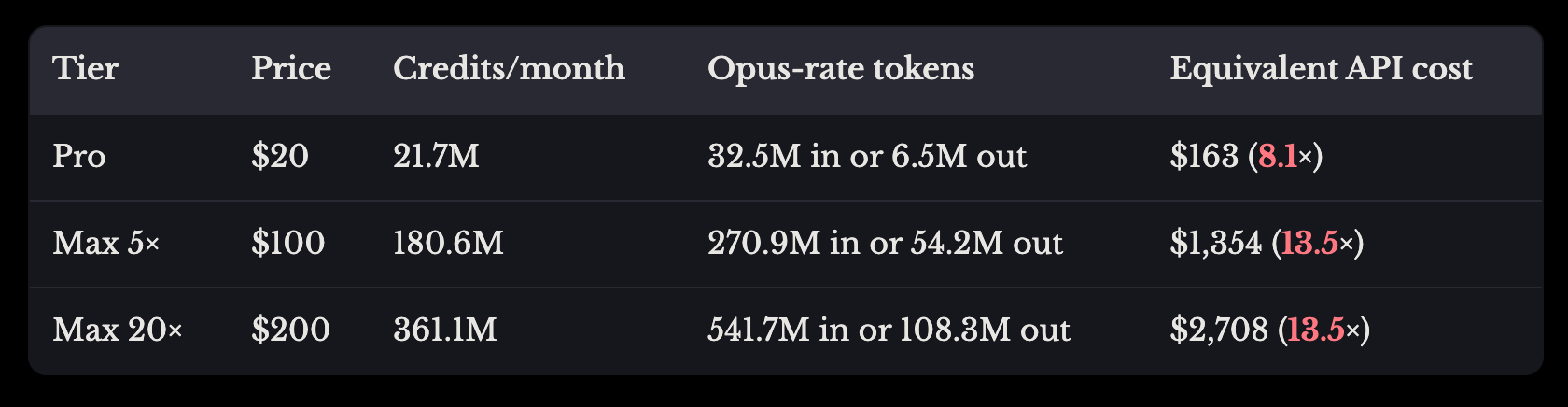

Claude tiene tres rangos de suscripciones: 20$ al mes, 100$ al mes y 200$ al mes.

Con eso puedes utilizar la interfaz de Claude, usar sus modelos, vibecodear cositas y lo que quieras.

La otra forma de usar Claude es mediante API. Una API es como un intermediario entre un software y otro. En este caso, entre tu proyecto/empresa/interfaz y el propio Claude. Eso tiene un precio. Recordemos que Anthropic gasta recursos en cómputo para que esto funcione, y se tiene que pagar.

Según un estudio (de un investigador random, debo admitir) un usuario que paga 200$ al mes puede gastar el equivalente a 2.700$ en peticiones a la API.

Hay más gente que ha hecho este cálculo.

Forbes publicó este viernes un artículo en el que hablaba sobre la situación de Cursor, una especie de competidor de Claude. Copio y pego (después de traducir con una IA, por supuesto) una parte del artículo:

Según una persona familiarizada con el análisis interno de la empresa, Cursor estimó el año pasado que una suscripción a Claude Code de 200 dólares al mes podría consumir hasta 2000 dólares en computación, lo que sugiere una subvención significativa por parte de Anthropic. Hoy en día, esta subvención parece ser aún más agresiva, ya que ese plan de 200 dólares puede consumir unos 5000 dólares en computación, según otra persona que ha consultado los análisis sobre los patrones de gasto en computación de la empresa.

Por si alguien se lo está preguntando: todos los datos son de ese estilo: investigaciones random y gente anónima hablando. Estas startups son empresas privadas y no tienen que publicar sus finanzas (al menos hasta que salgan a bolsa). De todas formas, son informaciones bastante factibles ya que, si fueran incorrectas y realmente las suscripciones fueran rentables, serían los primeros interesados en publicar esos números.

Un amigo me dijo que esto era como la suscripción de un gimnasio. La mayoría paga y luego no va. Pero no sé si estoy de acuerdo. Pienso en las IAs que usa la gente de mi alrededor. Sí, puede que haya alguno que pague ChatGPT y no le saque mucho partido, ¿pero Claude?

Uf. Los Claude Boys son diferentes.

Solo dos de mis amigos pagan Claude: Amayuscula y Miguelillo. Alguna vez los he mencionado en esta newsletter. Creedme cuando os digo que esos dos lúmpenes del internet han exprimido hasta el último céntimo de cómputo que les han permitido sus suscripciones.

Los Claude Boys no le dicen a un chatbot "haz un dibujito de cómo te trato uwu".

Los Claude Boys no saben qué película ver y vibecodean una app que decida por ellos. Luego instalan OpenClaw y le piden que organice su agenda semanal: dentista el martes, el resto libre.

La pregunta es: ¿lo harían si tuvieran que pagar el coste real?

🤷♂️

La idea es que los costes irán bajando con el tiempo, y que aunque ahora esté subsidiado por inversores, en un futuro será un negocio rentable donde el usuario pagará un precio asequible, similar a lo que paga ahora, pero que cubre gastos y da beneficios a Anthropic.

Pero tampoco parece que esté entre los planes de Anthropic (ni de sus competidores) reducir costes.

"¿Por qué no destina todo el mundo el 100% de su capacidad de cómputo al entrenamiento y no atiende a ningún cliente? Porque si no obtuvieran ningún ingreso, no podrían captar inversión, no podrían cerrar acuerdos de cómputo, no podrían comprar más capacidad de cómputo al año siguiente. Así que va a existir un equilibrio en el que cada empresa dedique menos del 100% al entrenamiento y, desde luego, menos del 100% a la inferencia. Debería quedar claro por qué no puedes limitarte a servir los modelos actuales y no entrenar nunca otro modelo, porque en ese caso no tendrías demanda alguna, ya que te quedarías atrás." Dario Amodei en una entrevista con Dwarkesh Patel.

Lo que dan a entender esas palabras de Amodei es que van a vivir en un bucle constante de inferencia y entrenamiento de nuevos modelos.

Si entrenar nuevos modelos es cada vez más costoso, y estos costes nunca desaparecen, la rentabilidad cada vez será más complicada.

Ya, pero Claude funciona

Pensé que me quedaba corto buscando artículos y leyendo estudios para escribir esta newsletter. En realidad no tiene sentido escribir sobre Claude sin ser usuario de Claude.

Por eso me registré y pagué la suscripción de 20$. En principio eso es suficiente para utilizar Claude Code, que es el buque insignia de Anthropic.

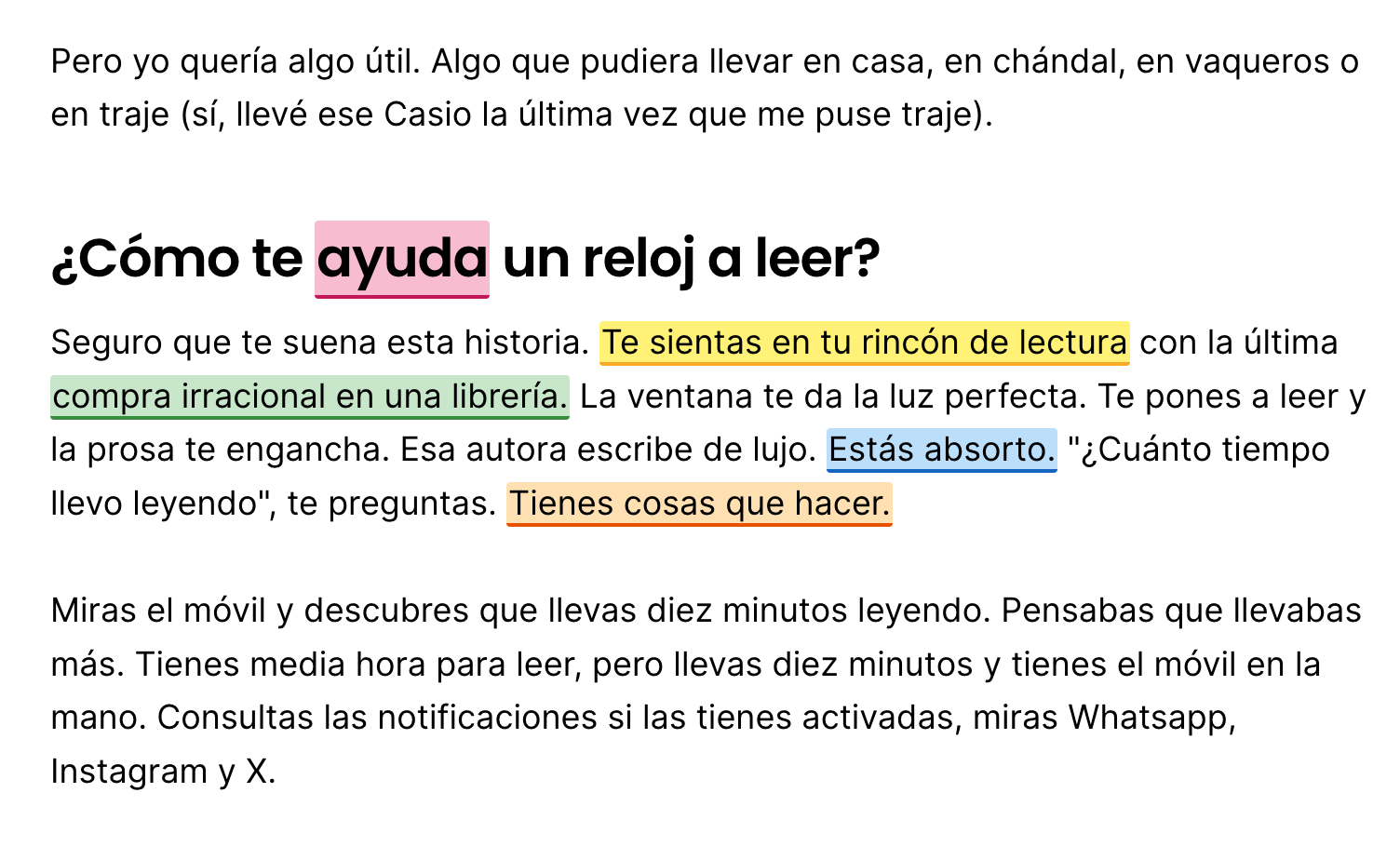

Para esta investigación he impreso bastantes artículos (unos cien folios de frikis hablando de IA), así que he ido subrayando cosas a mano. Pero muchos de los artículos han sido de consulta rápida: buscas una información y detectas una idea general que quieres destacar. No necesitas más de ese artículo, pero te interesa esa cita. Para esas ocasiones viene bien poder subrayar cosas en el ordenador, directamente desde el navegador.

Hace años tenía una extensión que lo hacía. Pero era un poco tosca. A veces dejaba de funcionar y olvidaba lo que había subrayado.

Claude Code me ha desarrollado la extensión en cinco minutos.

Es una extensión simple. Seleccionas un texto en cualquier página y te lo subraya automáticamente. Puedes escoger entre cinco colores. Cuando vuelves a la página, la extensión recuerda lo subrayado.

Claude Code es fácil de usar y, lo admito, impresiona.

Ya está, me estoy claudepilled.

Es broma.

Lo que más me impresiona que la gente piense que esto va a acabar con el trabajo de desarrollador de software. Es evidente que soy un mono con una metralleta. ¿Qué vulnerabilidades puede tener esa extensión? ¡Yo qué sé!

No es que no entienda el código. Es que ni lo he visto. El loquito de Claude me dio un archivo comprimido, lo subí a Chrome como desarrollador, y listo.

Luego se me ocurrió añadir unas nuevas funcionalidades. Que la extensión estuviera conectada a una pizarra, etc. Y ya está. Llegué al límite de lo que podía hacer vibecodeando.

La IA no funciona sola. Es más, parece un peligro programar sin tener ni idea de lo que haces. Ejemplos hay muchos, pero os voy a dar tres:

1- Instalar skills de desconocidos. Las skills son como unos archivos de instrucciones que se utilizan para mejorar cómo hace Claude tareas específicas. En este vídeo encontrarás la historia de un loquito que se inventó una skill que consistía en decirle a Claude que "pensara como Elon Musk". Cuando la gente se lo instalaba le salía "pawned". Podría haberlos infectado pero solo les vacilaba.

2- Exponer las claves APIs. Pongo un ejemplo de Gemini pero puede pasar en cualquiera. Si un actor malicioso compromete tu clave API se te puede subir la factura más que la factura de la luz en un pueblo de Wisconsin cerca de un centro de datos.

3- Lo más absurdo: superiores que confían demasiado en la IA. Aquí un programador cuenta cómo un jefe se ríe de él porque anticipa que necesitará unos días para hacer una tarea. "Si la IA lo hace en 15 minutos". También cuenta cómo le llama una madrugada con urgencia. Un cambio hecho con la IA ha roto el sistema.

Monos con metralletas.

¿Desarrollar software consiste en escribir líneas de código lo más rápido posible?

¿Escribir una novela consiste en teclear palabras?

¿O hay algo más?

Hay quien piensa que unos agentes en bucle van a sustituir realmente a unos humanos.

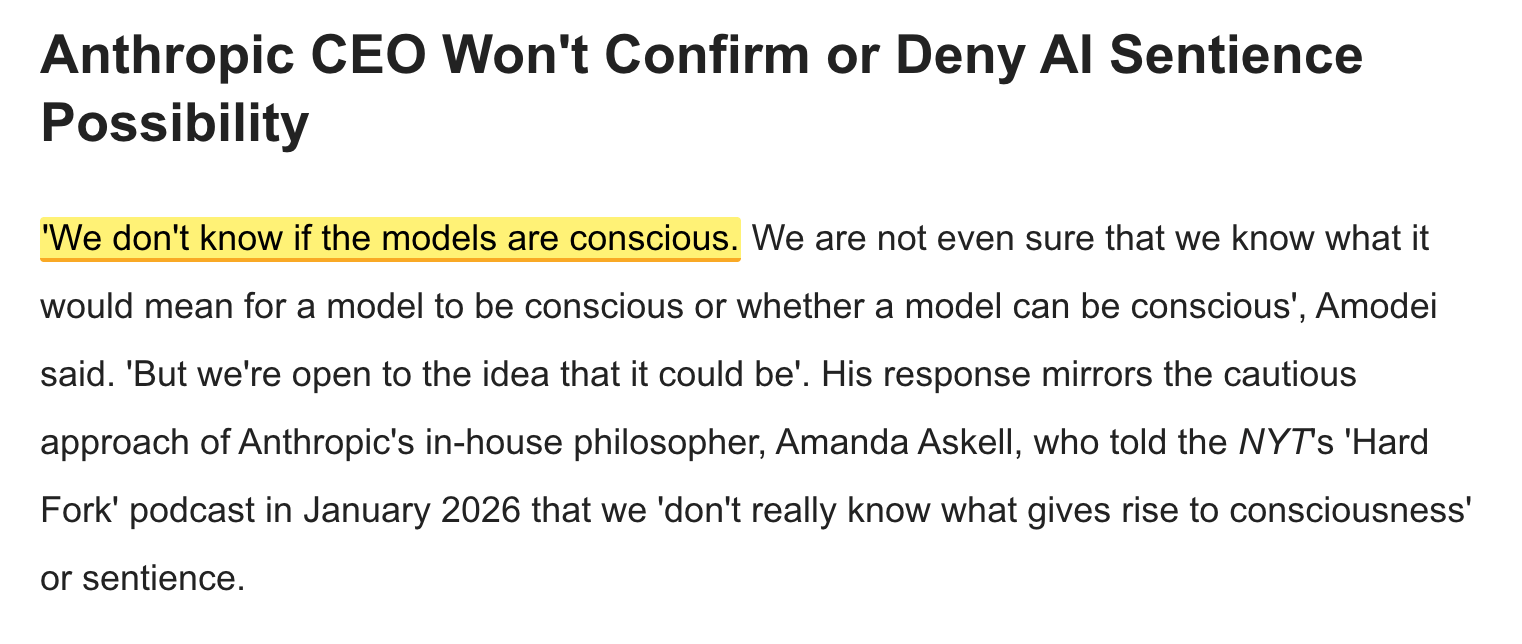

Pero, de haber, hay quien piensa que estos modelos ya podrían tener consciencia. Y es el propio Dario Amodei.

Es imposible no ver que Dario Amodei es un personaje. Interpreta el papel de un "friki" muy preocupado por el mundo y por lo que es correcto, y va soltando perlas a la prensa como un zorro astuto. La prensa, encantada de las visitas que atrae, lo amplifica todo, y el resultado es una de las campañas de marketing más grandes que he visto en mi vida.

Si has llegado hasta aquí, wow, gracias.

Se me ha ido un poco de las manos esta newsletter.

No pretendo robarte más tiempo.

Hoy en la UFC tenemos la repetición de Holloway vs Oliveira. Hay un chaval que me ha estado preguntando por instagram por quién apostar. No le he contestado. No quiero fomentar las apuestas entre mis seguidores.

Pero, sin ver el resultado, os digo por aquí que Oliveira.

Ahora veré.

Recuerda que puedes apoyarme hablando a tus amigos de esta newsletter.

Feliz domingo!

LD

Member discussion