Primera señal de pinchazo de la burbuja de la IA

Después de habernos acostumbrado a pagar para ver telenovelas turcas en 1080p (porque para verlas en 4K deberíamos pagar el doble), y después de acostumbrarnos a las suscripciones, ahora los tecnócratas dicen que lo que viene en el futuro es la suscripción "basada en tokens".

Esta semana, GitHub Copilot, una herramienta para programadores con un asistente de inteligencia artificial, ha anunciado que van pasarse a un modelo de pago por uso. Considero esta noticia como una de las primeras señales del pinchazo de la burbuja de la IA.

(Copilot) ha evolucionado desde un asistente en el editor a una plataforma agéntica capaz de ejecutar sesiones de codificación largas de varios pasos, utilizar los últimos modelos e iterar en repositorios completos. El uso de agentes se está convirtiendo en el valor predeterminado y conlleva demandas de cálculo e inferencia significativamente mayores.

Da la casualidad de que, como bien sabéis, llevo un tiempo vibecodeando una aplicación. Se trata de un procesador de texto sin ningún tipo de integración de inteligencia artificial que está orientado a gestionar fuentes y bibliografías de forma sencilla. Pero esa es otra historia.

La cuestión es que, con este experimento, me estoy dando cuenta de que los agentes de IA consumen una auténtica barbaridad, mucho más de lo que pensaba antes; mucho más de lo que pensaba cuando generaba imágenes y vídeos en busca del b-roll perfecto para el canal.

Empecé este proyecto con la suscripción de 20 $ al mes de Anthropic. Lo que descubrí fue que en 2 horas ya me había ventilado el límite de cinco horas y tenía que esperar otras 2 horas sacándome los mocos frente a la pantalla para volver a trabajar.

Me parece importante subrayar esto: para este tipo de uso, una suscripción de 20 $ al mes, incluso subvencionada, no sirve de nada.

Entonces pagué la suscripción de 100 $ al mes y empecé a trabajar.

Al principio funcionaba bastante bien, pero con el cambio de Opus 4.6 a Opus 4.7 volví a llegar a los límites muy rápidamente. La razón es que, aunque Anthropic haya dicho que el 4.6 y el 4.7 cuestan lo mismo, han hecho un discreto cambio en el tokenizador que cambia toda la matemática y hace que el Opus 4.7 sea más caro.

Es una estrategia engañosa hacia el consumidor, pero como esto es una "revolución tecnológica", parece que tienen permiso para hacer lo que les de la gana.

Eso lo explico mejor en la newsletter premium de esta semana.

La cuestión es que un día que había llegado al límite, estaba yo mirando las tórtolas por la ventana cuando me llegó una notificación de Anthropic que decía que ofrecían un modelo de pago por uso. Entonces hice el experimento. Puse mi tarjeta de crédito, activé la opción de pagar por uso, le di un señor prompt a una tarjeta gráfica recalentada en Nuevo Mexico, puse el godmode, aceptar todas las ediciones y listo. Me fui y volví una hora después.

Había gastado 25 euros, un cuarto de lo que pago todos los meses, en un solo prompt.

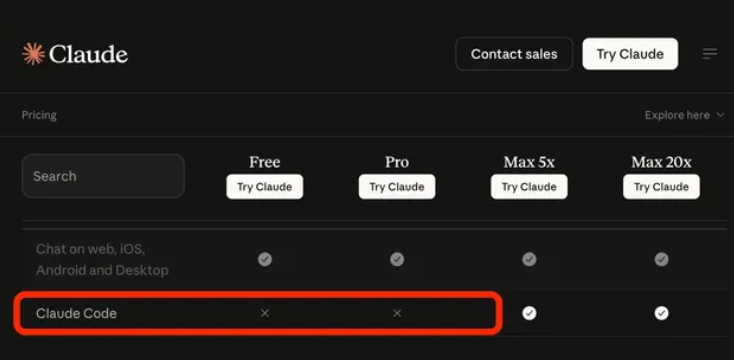

Poco después descubrí que Anthropic había quitado Claude Code a los usuarios de la suscripción de 20 dólares. Esto no fue ningún anuncio oficial. De hecho, lo que ocurrió fue que varios usuarios empezaron a sacar capturas en Twitter de cómo habían cambiado la página del pricing de los diferentes productos, y se ve claramente cómo en el nuevo pricing la suscripción de 20 dólares no incluía Claude Code.

Anthropic se defendió diciendo que esto era simplemente un test, un experimento, pero no deja de ser bastante siniestro. Es decir, están testando a ver si la gente seguiría pagando los 20 dólares sin darles el Claude Code. ¿Por qué? Porque la programación agéntica en Claude Code gasta una auténtica barbaridad y no pueden seguir subvencionando a sus clientes para siempre.

Tengo la teoría de que si no estuviera subvencionado, el vibecoding en gente que no tiene ni idea de programar, costaría miles de euros.

Si no eres un experto que sabe exactamente las instrucciones que le tiene que dar al agente, que le explica exactamente dónde tiene que buscar cierta documentación, dónde tiene que ejecutar lo que tenga que ejecutar... Si no sabes lo que estás haciendo, tus prompts van a ser vagos, genéricos y vas a hacer que el agente trabaje el doble, lo que significa que vas a gastar el doble de tokens.

Por eso están amagando con quitar Claude Code a los que solo pagan 20 $ al mes. Pero es muy posible que en un futuro incluso los que pagamos 100 $ o 200 $ al mes, tengamos que pagar por el uso real que estamos haciendo de estas herramientas y es posible que no estemos dispuestos a hacerlo. Me ha sorprendido en especial ver vídeos de Midudev, Mouredev y de gente de la comunidad de programadores, y leer en los comentarios que la gente está bastante preocupada por el precio. Es decir, pese a ser los que en un principio más beneficios reciben de la IA (descontando estafadores, por supuesto), están mostrando bastante sensibilidad al precio.

En los comentarios de estos vídeos puedes leer que están buscando fórmulas para optimizar sus prompts y gastar menos tokens. Muchos de ellos ni siquiera pretenden utilizar los modelos de "última frontera" como Opus 4.7 durante todo su trabajo. Algunos simplemente diseñan la arquitectura con el 4.7 o con el último GPT, pero luego ejecutan las tareas con modelos más baratos como Kimi. Por ahí he encontrado un comentario de un tío que dice ir rotando entre cuatro cuentas de Google distintas para usar Antigravity sin pagar. Desconozco si ese truco funciona de verdad.

Pero lo importante aquí son dos cosas:

- Llegado el momento, OpenAI, Anthropic y compañía dejarán de subvencionar a sus clientes y estos descubrirán que se han enganchado a un producto que no era lo que parecía.

- Si los clientes no se adaptan a este modelo de pago por uso y empiezan a buscar fórmulas como utilizar modelos más pequeños, más baratos, modelos de código abierto, modelos locales, etc., ¿qué va a pasar con la ingente cantidad de dinero que han metido los inversores en estas startups? ¿Cómo lo van a recuperar? ¿Quién va a seguir financiando los centros de datos?

Sobre esto y más cosas reflexiono en la newsletter exclusiva de esta semana: las cinco burbujas de la inteligencia artificial. Es un documento extenso de casi 20 páginas donde analizo diferentes titulares que se han dado últimamente y que creo que serán muy relevantes este 2026. Merece la pena imprimirlo y leerlo tranquilo. Puedes suscribirte por 6,99 euros al mes y apoyar este proyecto de periodismo independiente.

Gracias,

LD